L'IA figée en 1930 : quand l'ignorance devient une force

Talkie, le modèle qui s'est arrêté au seuil d'une époque

Mis en ligne fin avril 2026, Talkie est un modèle de langage pour le moins singulier : il n'a jamais rien lu après 1930. Pas un seul article de presse d'après-guerre, pas une ligne sur la Seconde Guerre mondiale, pas la moindre trace de l'ère numérique. Comme un voyageur temporel bloqué à l'aube des années trente, Talkie répond aux questions avec la seule connaissance du monde telle qu'elle existait avant que l'histoire ne bascule dans ses décennies les plus tumultueuses.

L'idée, aussi déroutante qu'elle puisse paraître, n'est pas un simple gadget nostalgique. Elle constitue une véritable expérience de pensée incarnée dans un outil fonctionnel. En interrogeant Talkie sur des sujets comme la politique internationale, les avancées scientifiques ou l'avenir de l'humanité, on obtient des réponses qui reflètent fidèlement les anticipations, les espoirs et les angles morts d'une époque révolue. Ses prédictions sont, selon les premiers utilisateurs, à la fois fascinantes et troublantes.

Ce projet soulève immédiatement une question fondamentale : que révèle un modèle sur ce qu'il ne sait pas ? Là où la plupart des LLM (Large Language Models) sont entraînés sur des corpus aussi vastes et récents que possible, Talkie fait le pari inverse. Il assume pleinement sa coupure temporelle, non pas comme une lacune à combler, mais comme une caractéristique constitutive de son identité et de sa valeur. C'est précisément cette limite volontaire qui en fait un outil d'analyse unique, capable de mettre en lumière la façon dont les données d'entraînement façonnent - et parfois déforment - la vision du monde d'une intelligence artificielle.

Pour en savoir plus sur les origines et les premières réactions autour de ce projet, vous pouvez consulter l'article de Numerama consacré à Talkie, qui détaille les premières expériences menées avec ce modèle hors du commun.

En somme, Talkie n'est pas simplement un LLM avec une date de coupure ancienne. C'est un miroir tendu vers le passé, mais aussi - et surtout - vers nos propres présupposés sur ce que doit être une intelligence artificielle : omnisciente, à jour, exhaustive. En remettant en cause ces critères, Talkie ouvre un débat bien plus profond sur la nature même de la connaissance artificielle.

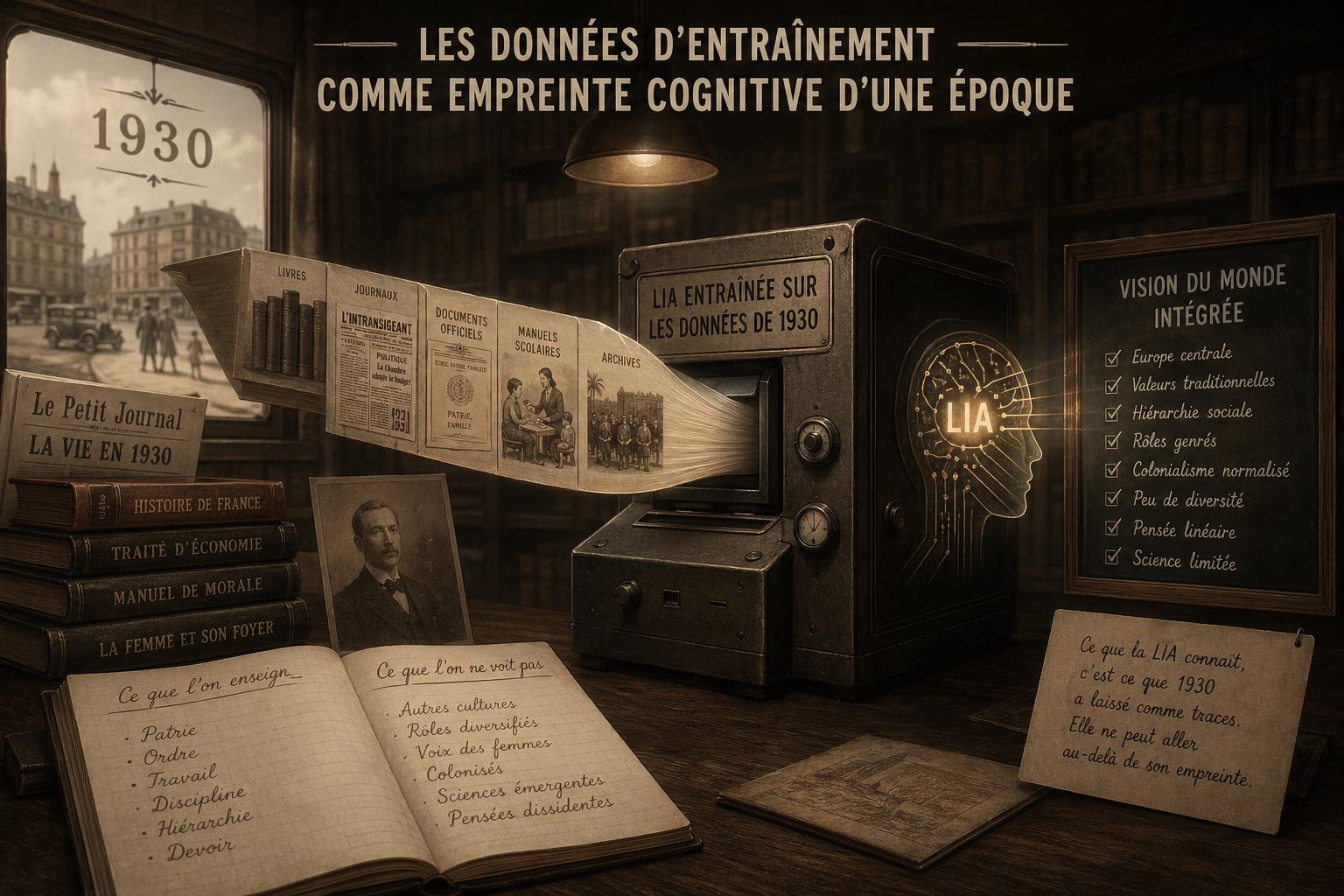

Les données d'entraînement comme empreinte cognitive d'une époque

Pour comprendre ce que Talkie révèle, il faut d'abord saisir ce que signifie, techniquement et philosophiquement, entraîner un modèle de langage sur un corpus délimité dans le temps. Chaque LLM est, en réalité, le produit de ses lectures. Il ne pense pas : il reproduit, recompose et extrapole à partir des patterns statistiques présents dans les textes qui lui ont été soumis. En ce sens, un modèle entraîné sur des données antérieures à 1930 ne parle pas seulement du passé - il est le passé, au sens cognitif du terme.

Les textes produits avant 1930 portent en eux les biais, les certitudes et les ignorances de leur époque. On y trouve une confiance absolue dans le progrès industriel, une vision du monde encore largement eurocentrée, des théories scientifiques aujourd'hui dépassées, et une absence totale de conscience des catastrophes à venir : la Grande Dépression de 1929 venait tout juste de commencer, Hitler n'était pas encore au pouvoir, et l'atome n'avait pas encore livré ses secrets les plus terribles. Talkie, nourri de ces textes, reproduit donc fidèlement cette vision du monde - avec toutes ses lacunes.

Ce phénomène n'est pas propre à Talkie. Tous les modèles de langage sont, d'une certaine façon, des instantanés cognitifs de leur époque d'entraînement. Les LLM contemporains, entraînés sur des données allant jusqu'en 2024 ou 2025, portent eux aussi des biais : surreprésentation de certaines langues, de certaines cultures, de certains points de vue politiques ou économiques. La différence, c'est que ces biais sont souvent invisibles, noyés dans l'immensité du corpus et masqués par une apparence d'exhaustivité.

Talkie, lui, rend ses biais visibles et assumés. En sachant exactement ce qu'il ne sait pas, l'utilisateur peut interpréter ses réponses avec un recul critique que les modèles généralistes ne permettent pas toujours. C'est une leçon précieuse pour tous ceux qui travaillent avec des IA : la transparence sur les limites d'un modèle est souvent plus utile que l'illusion d'une connaissance totale.

On peut ainsi dresser un parallèle instructif entre Talkie et les modèles modernes :

- Talkie (corpus pré-1930) : biais temporels explicites, ignorance assumée, valeur heuristique forte pour l'analyse historique.

- LLM contemporains : biais temporels implicites, illusion d'exhaustivité, risque de confiance excessive de la part des utilisateurs.

- Modèles spécialisés (médical, juridique, etc.) : corpus délimité par domaine, biais sectoriels, mais temporalité souvent floue.

Cette comparaison montre que la délimitation volontaire du corpus n'est pas nécessairement un handicap. Elle peut, au contraire, constituer un gage de fiabilité et de lisibilité pour des usages bien définis.

La temporalité de l'IA : une question trop souvent négligée

L'un des angles les plus stimulants que Talkie met en lumière est celui de la temporalité des modèles de langage. Dans le débat public sur l'IA, on parle beaucoup de puissance de calcul, de taille des modèles, de capacités de raisonnement. Mais la question du quand - c'est-à-dire de la période couverte par les données d'entraînement - est souvent reléguée au second plan, mentionnée en passant sous l'étiquette de

Besoin d'accompagnement en IA ?

Nos experts vous aident à identifier et déployer les solutions d'intelligence artificielle adaptées à votre entreprise.

Consultation stratégique offerte